На фоне полномасштабной войны Украина одновременно держит еще один малозаметный, но стратегический фронт — технологический. И это — отстаивание независимости и конкурентоспособности нашей страны в сфере технологий искусственного интеллекта. Именно здесь решается, каким будет украинское цифровое государство будущего — независимым и защищенным или уязвимым к внешнему влиянию. Сможет ли оно формировать свою политику по ИИ (AI)?

Кто и как должен формировать ее — министерские департаменты, иностранные корпорации или наше научное сообщество? Ответ очевиден — нужно широкое общественное обсуждение и системный диалог с экспертной средой. Сама общественность уже делает первые шаги в этом направлении. Например, создан независимый Национальный научно-экспертный совет по развитию, регулированию и международному партнерству в сфере искусственного интеллекта, куда вошли эксперты, которые работают с технологиями искусственного интеллекта в разных отраслях — от медицины до права и обороны.

Они предложили свое видение основных проблем и возможных решений в этой сфере.

Вызов первый: как Украина может избежать «копипаста» чужих законов о ИИ

Украина рискует стать полигоном для чужих технологий и регуляций, если и дальше просто будет заимствовать внешние модели — в частности такие, как AI Act, который определяет правила использования ИИ в европейских странах. Прямая адаптация таких документов игнорирует украинский контекст: полномасштабную войну, цифровые атаки и гибридные угрозы.

Что делать? Украина может и должна разработать свой закон об ИИ с учетом военного опыта, технологических прорывов и национальных потребностей. За время войны страна сделала значительный прыжок от использования ИИ в военных системах до электронного управления, медицины, права и образования.

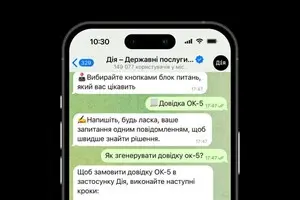

Вместе с тем идея «национального ИИ» как единой централизованной системы сегодня выглядит слишком сложной для реализации. Более эффективным подходом может стать создание отраслевых технологических хабов — специализированных центров знаний и решений в конкретных сферах: Med AI (медицина), Law AI (право), Military AI (оборона). Это сети специалистов, учреждений и цифровых платформ, которые объединяют ресурсы, данные и экспертизу для разработки практического применения ИИ. Такие хабы могут действовать автономно, но в синергии, формируя основу новой цифровой государственности.

Вызов второй: как адаптировать украинскую правовую систему к новым коллективным формам угрозы, возникающим из-за применения искусственного интеллекта — особенно в условиях войны

Как подчеркивает профессор, заместитель директора Института государства и права имени В. Корецкого НАН Украины по научной работе академик НАПрНУ доктор юридических наук Наталья Онищенко, классические подходы к правам человека и народов не успевают за реальностью цифровой войны. Украинская юриспруденция не готова к новым формам угроз, которые возникают на пересечении технологий и коллективных прав. Традиционно она лучше реагирует на нарушение прав отдельного человека. Но современная война (в частности информационная и цифровая) все чаще бьет по коллективным субъектам — народам, сообществам, культурам. В результате из поля зрения выпадают сложные явления, где эти измерения пересекаются, — как например геноцид. Алгоритмы искусственного интеллекта могут быть использованы для таргетированного разжигания ненависти, уничтожения цифровых архивов, перезаписи истории, маргинализации языка и культуры в глобальном информационном пространстве.

Что делать? Если будущий закон об ИИ не увидит этих рисков, он может превратиться в нейтральный технический документ, который регулирует «алгоритмы», но не защищает народ как коллективный субъект. Речь идет о защите языка, памяти, культуры, репутации сообществ в глобальном цифровом пространстве.

Вызов третий: как не превратить гражданина в пользователя

Профессор, доктор юридических наук, заместитель руководителя Департамента по вопросам гражданства, помилования, государственных наград офиса президента Украины Дмитрий Журавлев предлагает посмотреть на ИИ не только как на технологию, а как на вызов для гражданской культуры.

С юридической точки зрения мы хорошо понимаем, что такое гражданство: это четко оформленная связь лица с государством с прописанными правами, обязанностями и гарантиями. Зато гражданственность (внутреннее ощущение ответственности, солидарности, готовности действовать в интересах общего блага) остается почти без внимания права.

В цифровую эпоху этот пробел становится опасным. С одной стороны, гражданин превращается в «пользователя» государственных сервисов и платформ. С другой — крупные языковые модели, созданные преимущественно корпорациями, постепенно создают в обществе опасную формулу: «знание не в человеке, а в ИИ». Образование, которое массово интегрирует технологии искусственного интеллекта в учебный процесс, нередко делает это без достаточных предохранителей, фактически передавая интеллектуальную и смысловую инициативу внешним технологическим игрокам — разработчикам технологий, созданным не в Украине, не всегда прозрачным в своей работе и руководствуются коммерческими, а не образовательными целями.

Дмитрий Журавлев предупреждает, что именно в этом пересечении и проявляется кризис гуманитарной основы цифрового государства: если мы не сохраним ответственного гражданина, государство рискует превратиться в техническую платформу, которая работает, но не имеет ценностного содержания.

Что делать? Нужно создать свои академические и секторальные модели ИИ в рамках украинской юрисдикции. Речь идет не об очередном «черном ящике», который работает автономно и непрозрачно, а об открытой системе, разработанной в сотрудничестве с украинским научным и образовательным сообществом. Такие модели должны работать с четко определенными наборами данных, этическими принципами и прозрачными механизмами аудита.

Академические модели — это системы ИИ для образования и науки, которые создают в университетах или исследовательских центрах (например, для лингвистики, истории или педагогики). Секторальные модели — это специализированные ИИ-решения для конкретных сфер: медицины, права, обороны и т.п.

Вызов четвертый: как обеспечить стратегический контроль над внедрением ИИ в основных сферах — медицинской, правовой и оборонной, и не превратиться в сырьевой придаток для глобальных разработчиков?

Украинские разработки в области Med AI, Law AI и Military AI уже вызывают интерес как у союзников, так и у нейтральных или враждебных игроков. Без четкой стратегии мы рискуем выступать только донором идей, не имея своего влияния в международных дискуссиях об этике и регулировании ИИ.

Адвокат, доцент кафедры служебного и медицинского права УНИ права Киевского национального университета имени Тараса Шевченко, член Совета директоров и глава Комитета по профессиональной практике Всемирной ассоциации медицинского права кандидат юридических наук Радмила Гревцова акцентировала внимание на недостаточно урегулированной сфере — защите медицинских данных. Создание цифровых моделей тела человека, органов, историй болезни (так называемых медицинских симулякров) открывает новые возможности для диагностики и обучения. Но вместе с тем создает серьезный риск утечки персональной информации, особенно если используются иностранные корпоративные модели ИИ. Украинское право пока не дает четкого ответа, как именно защищать такие данные.

Доцент, заместитель главы Государственной службы Украины по лечебным средствам и контролю над наркотиками, профессор кафедры прикладной медицины Университета «КРОК» доктор медицинских наук Владимир Короленко подчеркнул: по уровню значимости искусственный интеллект в медицинской сфере уже равен ИИ в военной. Речь идет не только о поддержке военных или оптимизации медицинской системы, но и о психическом здоровье общества в целом. Ошибки алгоритмов в сфере лечения или психологической поддержки могут иметь длительные последствия, которые сложно исправить стандартными механизмами контроля.

Что делать? Реалистичная модель на ближайшие годы — это создание сильных, защищенных кластеров Med AI, Law AI, Military AI, которые работают как лаборатория будущего и ядро цифрового государства. Они должны объединять науку, бизнес, государство и силовой блок, но на условиях прозрачности, этических стандартов и четких режимов доступа к данным.

Все эти вызовы требуют системных и срочных решений. В условиях войны времени на ошибки нет. Украина имеет шанс сформулировать свои отраслевые защищенные модели искусственного интеллекта — с опорой на свой опыт, вызовы и стратегические интересы. Иначе рискует остаться полигоном для чужих решений и технологических экспериментов.

Войти с помощью Google

Войти с помощью Google