Останній прорив в галузі штучного інтелекту може призвести до автоматизації чверті роботи, яка виконується в США та єврозоні, повідомляє Financial Times із посиланням на дослідженням Goldman Sachs.

Інвестиційний банк заявив у понеділок, що системи штучного інтелекту на кшталт ChatGPT, які можуть створювати контент, що неможливо відрізнити від людського результату, можуть спровокувати бум продуктивності, який, зрештою, упродовж майбутніх 10 років збільшить річний світовий валовий внутрішній продукт на 7%.

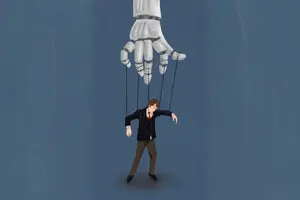

Водночас, якщо технологія виправдає свої обіцянки, вона може призвести і до «значного руйнування» ринку праці, автоматизувавши роботу 300 мільйонів працівників, які працюють повний робочий день у великих економіках.

Серед тих, хто має найбільший ризик виявитись зайвими — юристи та адміністративний персонал. Автори дослідження підрахували, що певного ступеня автоматизації на основі даних про завдання, які зазвичай виконуються в тисячах професій, зазнають приблизно дві третини робочих місць у США та Європі. Робоче навантаження решти людей скоротиться майже наполовину і вони, ймовірно, продовжуватимуть працювати, звільнивши частину свого часу для більш продуктивної діяльності.

У США автоматизація торкнеться 63% робочої сили. Ще 30% працівників, зайнятих на фізичній роботі або на відкритому повітрі не постраждають, хоча їхня робота може бути чутливою до інших форм автоматизації.

Однак близько 7% американських працівників працюють на роботах, де принаймні половину їхніх завдань міг би виконати генеративний ШІ, і вони вразливі до заміни. За даними дослідження Goldman, подібний вплив штучний інтелект матиме і у Європі.

Звіт спричинив низку дискусій щодо потенціалу технологій штучного інтелекту як для відновлення зростання продуктивності в багатих країнах, так і для створення нового класу позбавлених власності «білих комірців», які ризикують повторити долю робітників на виробництві в 1980-х роках.

Втім, загалом оцінки Goldman щодо впливу ШІ є більш консервативними, ніж оцінки деяких інших академічних досліджень, які прогнозують вплив штучного інтелекту на більш широкий спектр пов’язаних технологій. У опублікованій минулого тижня компанією OpenAI, розробником GPT-4, статті йдеться про те, що 80 % робочої сили США принаймні 10% своїх завдань можуть перекласти на генеративний штучний інтелект.

Європол цього тижня також попередив, що швидкий прогрес генеративного ШІ може стати у пригоді онлайн-шахраям і кіберзлочинцям, відтак «темні мовні моделі» можуть стати ключовою кримінальною бізнес-моделлю майбутнього.

Якщо корпоративні інвестиції в штучний інтелект продовжуватимуть зростати такими ж темпами, як інвестиції в програмне забезпечення в 1990-х роках, лише в США до 2030 року вони можуть наблизитися до 1 відсотка ВВП.

Оцінки Goldman базуються на аналізі даних зі США та Європи щодо завдань, які зазвичай виконуються в тисячах різних професій. Дослідники припустили, що ШІ зможе виконувати такі завдання, як заповнення податкових декларацій для малого бізнесу; оцінка страхового відшкодування, або документування результаті огляду місця злочину. Використання ШІ для більш чутливих завдань, таких як винесення судових рішень, перевірка статусу пацієнта в реанімації, або вивчення міжнародного податкового законодавства, дослідниками не розглядалось.

Увійти за допомогою Google

Увійти за допомогою Google