В швейцарском Давосе состоялись панельные дискуссии в рамках Всемирного экономического форума. В этом году одной из ключевых тем обсуждений стали новые технологии и, в частности, развитие искусственного интеллекта.

Основные дискуссии велись относительно того, каким образом можно регулировать технологию, не мешая ее развитию, а также того, как искусственный интеллект может повлиять на жизнь людей.

Вопросы регулирования ИИ

Сомнений в необходимости регулирования технологии уже практически не осталось. Искусственный интеллект проникает во все сферы жизни людей, от образования и работы до выполнения повседневных задач. Но все же, установление жестких рамок, в которых необходимо двигаться, может привести к замедлению развития технологии или даже ее смерти.

Генеральный директор компании IBM Арминд Кришна заявил о том, что необходимо регулировать не технологии, а их применение.

«Очень тяжело регулировать саму технологию, потому что это останавливает инновации. Регулируйте пути использования. Чем более рискованным является способ использования, тем более регулированным он должен быть. Это подход который можно и нужно использовать», - заявил он.

Кроме того, по словам Кришны разработчиков технологий необходимо сделать юридически ответственными в случае, если они допустят их некорректное использование.

Дискуссии коснулись так же того, достаточно ли законов работотехники, сформулированных Айзеков Азимовым, для регулирования деятельности роботов, которые работают под управлением искусственного интеллекта.

Айанна Говард из Университета Огайо заявила, что такого рода принципов недостаточно, необходимо прописать и другие ограничения или возможности. По ее словам, мир не делится на черное и белое, в нем много серого. И роботы должны научиться принимать решения в рамках этого «серого».

«Подумайте о "не причинять вред" с такой точки зрения. У меня пожилые родители, им нужно принимать лекарства. И мой домашний робот должен им их давать. Но если они говорят нет, не хотят принимать лекарства, что вы будете делать? Как родитель или ребенок вы примете решение, что нужно применить небольшое принуждение. Что делать, если я робот-охранник и охраняю дом, в который заходит грабитель? Я не должен причинять вред человеку и просто пропустить грабителя?», - пояснила она.

Влияние ИИ на рабочие места

В последнее время все чаще звучит мнение о том, что искусственный интеллект и роботы заберут рабочие места у людей. Так, исследование Goldman Sachs показало , что генеративный ИИ может поставить под угрозу 300 миллионов рабочих мест в крупных экономиках. Технологии могут увеличить мировой ВВП на 7%, но привести к «значительному разрушению» рынка труда.

В Давосе Хади Партови, генеральный директор Code.org заявил о том, что работу у людей забирает не искусственный интеллект, а люди, которые умеют им пользоваться.

«Когда люди думают о риске потерять работу из-за ИИ, риск заключается не в том, что работу отберет ИИ. Ее отдадут тому, кто умеет пользоваться ИИ. И это будет гораздо большее замещение. Речь не о том, что работников заменят машины, особенно в случае с работой в офисе. А о том, что лучше или современней образованный человек может быть в пять раз более продуктивным. И это увеличивает важность обучения тому, как использовать эти инструменты», - заявил он.

Главный исполнительный директор Sanofi Пол Хадсон заявил о том, что ИИ не забирает работу, а меняет ее природу. Люди не хотят заниматься определенными рутинными задачами и передают их искусственному интеллекту.

Кристи Хоффман, генеральный секретарь UNI Global Union, добавила, что согласно исследованию к 2030 80% средних работников смогут выполнять объем работы, на который сейчас нужно пять дней, за четыре дня. А это поднимает вопрос о том, нужно ли переходить на четырехдневную рабочую неделю.

«Мы должны думать шире и об изменении структуры рабочей недели. Не обязательно 20% людей потеряют рабочие места, возможно мы просто перейдем к четырехдневной рабочей неделе», - заявила она.

Перспективы развития ИИ

Затронули в Давосе и тему того, каким может быть развитие технологии в ближайшем будущем и в более отдаленной перспективе.

Так, генеральный директор компании Intel Пэт Гелсингер заявил о том, что в ближайшие годы разработчики должны не только стремиться обучить свои модели, но и понять, как их можно использовать, как их перенести из больших центров данных в каждое устройство, доступное пользователям.

Он также отметил, что модели ИИ должны научиться думать не только быстро, но и правильно. А это критически важно, если они будут повсеместно представлены в нашей жизни.

Один из основателей и генеральный директор Cohere Inc. Эйдан Гомес заявил о том, что развитие невозможно, если исследователи в этой области будут идти по тому же пути, что и сейчас. По его словам, нейросети, как и люди, должны обучаться самостоятельно и самосовершенствоваться.

«До этого вы могли остановить любого на улице и попросить его обучить модель. И это улучшило бы ее качество. Но они становятся действительно умными. Уже нельзя подойти к простому прохожему. Нужно звать магистра математики или студента-биолога. А потом доктора наук. А потом кого? Человечество и его знания – это верхний предел для существующей стратегии. И мы должны выйти за эти рамки», - заявил Гомес.

Профессор информатики Стенфордского университета, основательница и генеральный директор Insitro Inc Дафна Коллер подчеркнула, что для развития искусственного интеллекта ему нужно дать возможность экспериментировать с внешним миром. Именно так развивается интеллект человека, так можно развить и компьютеры.

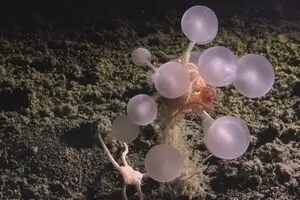

Опасности использования данных

Развитие искусственного интеллекта, нейротехнологий и других технологий делает все более актуальным вопрос о необходимости защиты данных людей. По словам экспертов, люди могут не в полной мере осознавать опасности виртуального мира и глобальной сети, не говоря уже о технологиях, которые прямо или неинвазивно считывают информацию с мозга.

Так, Морис Леви, глава наблюдательного совета Publicis Groupe, заявил о том, что каждый, кто пользуется интернетом, уязвим. По его словам, как только человек выходит онлайн, он подвергается риску вымогательства или же того, что его аккаунты будут взломаны хакерами.

Эксперт по защите прав человека и преподаватель Гарвардского университета Британ Хеллер заявила о том, что на данный момент люди не полностью понимают, какой массив данных передают, сталкиваясь с технологиями дополненной реальности, а существующие нормы по защите личных прав не могут в полной мере защитить человека в цифровом мире.

События же, которые происходят в виртуальной реальности, воспринимаются мозгом и телом человека как реальные. Поэтому люди должны четко понимать, что они отдают и принимают, сталкиваясь с технологиями дополненной реальности.

Американский психолог, когнитивист, исследователь ИИ и писатель Гэри Маркус во время обсуждения развития нейротехнологий заявил о том, что в будущем они могут превратиться в Троянского коня. В качестве объяснений он привел пример с Facebook.

«Подумайте о Facebook. Вы думали, что общаетесь с друзьями, но что они делали на самом деле – собирали очень подробные данные и работали с другими продавцами. И здесь произойдет то же. О вас будут собраны настолько подробные данные, насколько возможно, чтобы продать ваш персонализированный портрет», - считает эксперт.

Войти с помощью Google

Войти с помощью Google