Сучасні діпфейки імітують серцебиття, а це один з найважливіших критеріїв, за допомогою яких їх вдавалося розрізняти. Це може бути результатом все більшої точності, із якою штучний інтелект (ШІ) компілює підробки на основі реальних відео, пише IFLScience.

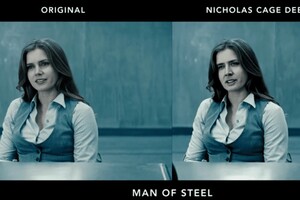

Діпфейки – це відео, згенеровані ШІ, які демонструють ніби-то реальних людей у місцях і під час подій, яких не було насправді. Технологія використовується, наприклад, в TikTok для створення жартівливих роликів, де користувачі постають в образі тварин або в кумедних ситуаціях. Водночас зловмисники використовують цей інструмент для створення компрометуючих відео. Наприклад, на початку повномасштабного вторгнення росіяни поширювали діпфейк із президентом Володимиром Зеленським, який нібито оголошував капітуляцію. Але обман був швидко розкритим.

Для ефективного виявлення діпфейків розробники створили детектори - програмне забезпечення, яке ефективно розпізнавало відео, згенероване ШІ. Одним з таких розробників є професор Берлінського університету Гумбольдта Петер Айзерт. Він виступив із заявою про нові виклики, які постали перед викривачами діпфейків.

«…Нещодавні високоякісні відео з діпфейками можуть мати реалістичне серцебиття та незначні зміни кольору обличчя, що значно ускладнює їх виявлення», – зазначив професор.

Серцебиття – один з основних критеріїв, на якому базувалося це розпізнання. Детектори використовують той самий принцип, що і пульсоксиметри: пропускання світла через шкіру та кровоносні судини. Цей принцип ефективний навіть при огляді пацієнтів через вебкамери і в такому випадку називається фотоплетизмографія (rPPP).

Детектори використовують rPPP при аналізі відео. Масштабні тестування фахівців Берлінського університету Гумбольдта підтвердили, що цей підхід є ефективним. Але нещодавно з’явилися діпфейки, які можуть обманути його.

ШІ-експерти висувають гіпотезу, що під час створення фальшивих відео штучний інтелект більш якісно копіює тіло людини. Це може бути зроблено як спеціально для більшої правдоподібності, так і випадково. Прецедент насторожує, вважає Петер Айзерт. Але є й надія.

«Наші експерименти показали, що сучасні діпфейки можуть показувати реалістичне серцебиття, але не здатні зімітувати фізіологічно реалістичні варіації кровотоку обличчя в просторі та часі», – зазначив професор.

Він додав, що саме цей елемент розробники намагатимуться включити в роботу детекторів.

З часу появи діпфейків постійно вдосконалюється і система розпізнання. Окрім серцебиття, алгоритми також розпізнавали фальшиві фото і відео, аналізуючи відображення в очах. Інструмент показав ефективність 94% при розпізнанні підроблених фотографій.

Увійти за допомогою Google

Увійти за допомогою Google