Обзоры искусственного интеллекта (AI Overviews) в поиске Google демонстрируют высокую, но не абсолютную точность. Исследование The New York Times и стартапа Oumi показало, что система может генерировать миллионы ошибочных ответов каждый час. Проблемы возникают как из-за неточных источников, так и из-за самого принципа работы ИИ.

Функция AI Overviews, которую Google начала активно внедрять в 2024 году, меняет подход к поиску, превращая компанию из агрегатора информации в ее непосредственного издателя. Ответы, созданные искусственным интеллектом, отображаются в верхней части страницы и выглядят убедительно.

Впрочем, анализ Oumi показал, что эти ответы точны примерно в 85% случаев для модели Gemini 2 и 91% — для более новой Gemini 3. Учитывая более пяти триллионов поисковых запросов в год, это означает десятки миллионов ошибок каждый час.

Исследователи также установили, что более половины правильных ответов являются "необоснованными". Это означает, что приведенные источники не полностью подтверждают информацию, которую генерирует система. При анализе среди более 5 тысяч ссылок значительную долю составляли сообщения из Facebook и Reddit, которые входили в наиболее часто цитируемые источники.

Ранее исследование платформы SE Ranking, которая проанализировала более 50 тысяч запросов в Германии, выявило, что AI Overviews в ответах на запросы о здоровье чаще всего цитирует YouTube, а не специализированные медицинские издания. Результаты тогда вызвали беспокойство относительно надежности инструмента из-за использования сомнительных источников в важных вопросах.

В исследовании Oumi, AI Overviews неправильно указал год открытия Музея Боба Марли, назвав 1987-й вместо 1986-го и опирался на противоречивые источники. Также система ошибочно определила реку, граничащую с западной частью Голдсборо, хотя достоверный источник отмечает, что река протекает через город, — когда Google идентифицирует веб-сайт с правильной информацией, он все равно может генерировать ложный ответ.

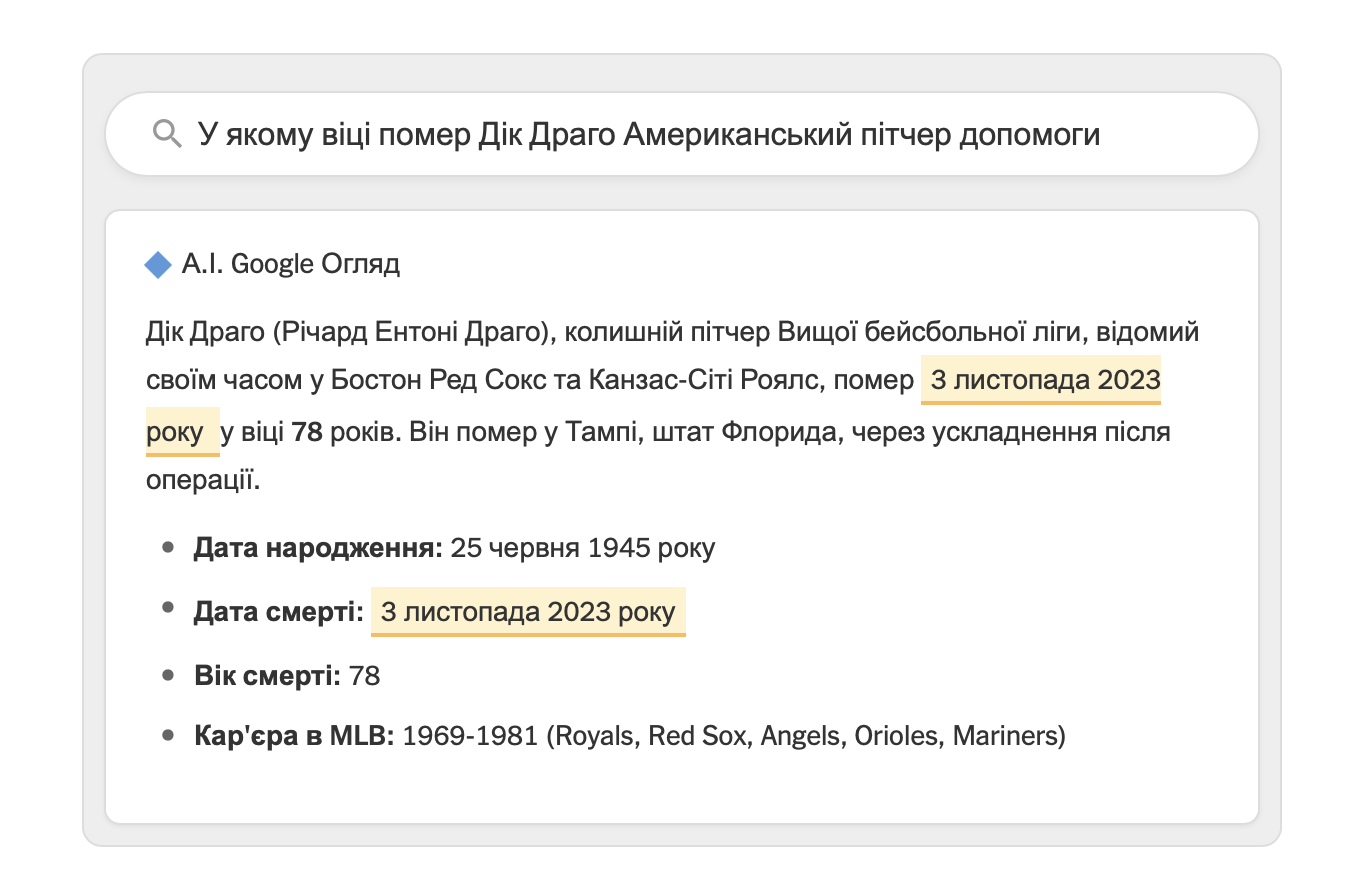

Иногда ошибки возникают даже тогда, когда ответ в целом правильный. Система может добавлять неправильные детали, как это произошло с информацией о дате смерти бейсболиста Дика Драго, который ушел из жизни 2 ноября 2023 года.

Дополнительной проблемой является возможность манипуляций. Как отмечают эксперты, достаточно опубликовать недостоверную информацию в блоге, чтобы она попала в ответы ИИ.

Журналист Томас Жермен проверил это на практике, создав вымышленное сообщение о "Лучших едоках хот-догов среди технических журналистов". Уже на следующий день поиск Google выдал эти данные как реальный факт.

"Он выкладывал информацию с моего веб-сайта так, будто это была сама истина", — заявил журналист.

В Google признают, что система может ошибаться, и предупреждают пользователей проверять информацию. В то же время компания критикует методологию исследования Oumi, заявляя, что оно "имеет серьезные пробелы" и не отражает реальные поисковые запросы.

Эксперты отмечают, что проблема носит системный характер. Современные ИИ-модели работают на основе вероятностей, а не четких правил, поэтому ошибки остаются неотъемлемой частью.

Новое исследование появилось через несколько месяцев после расследования The Guardian, которое выявило случаи распространения ложной медицинской информации через AI Overviews. В одном из них Google предоставил ложные данные о тестах функции печени, что могло ввести пользователей в заблуждение. После критики компания убрала AI Overviews для части медицинских запросов, но не для всех.

Войти с помощью Google

Войти с помощью Google