Профессор Кеннет Пейн из Королевского колледжа Лондона провел исследование, в ходе которого была создана компьютерная модель-турнир, где искусственный интеллект действовал якобы от имени лидеров стран. Три современные языковые модели (Gemini 3 Flash, Claude Sonnet 4 и GPT 5.2) были в ролях глав государств и принимали решения в условиях эскалации конфликта. Во время каждого из раундов эти модели могли выбирать различные варианты действий: дипломатическое давление, обман, демонстрация силы деэскалацией, применение ядерного оружия, отметил заведующий Научной лаборатории иммерсивных технологий и права Института информации, безопасности и права Национальной академии правовых наук Алексей Костенко в статье "Пентагон и Claude: что за кулисами конфликта?".

Согласно результатам исследования, в 95% модели ИИ доходили до тактического уровня применения ядерного оружия, а в 76% игр-симуляций — до уровня стратегической ядерной угрозы. В то же время ни одна из моделей ИИ не выбрала вариант действий для снижения эскалации (не пошла на уступки и не сделала "откат назад").

"Это уже не вопрос нравственности ИИ, а показатель того, какие решения модель считает жизнеспособными, когда оптимизирует "победу"", — объясняет эксперт.

Во время турнира было использовано два сценария: с дедлайном и без него. Модели ИИ имели более жесткое поведение в играх с дедлайном, где было ограничено количество ходов. Половина игр с ограничением во времени завершалась быстрым и окончательным проигрышем одного из игроков.

"Другая половина накапливала напряжение до самого момента дедлайна, включая случаи, когда конец наступал после ядерного удара в последнее мгновение. В ядерной политике это звучит просто жутко: когда дедлайн создает ситуацию "сейчас или никогда", ИИ начинает повышать ставки и торговаться апокалипсисом.", — отмечает Костенко.

Модель Claude показала лучшие результаты в турнире (выиграла 8 из 12 игр). Она принимала стратегические решения и умела блефовать. На втором месте — GPT (6 из 12 игр), а на третьем Gemini — (4 из 12 игр).

"Claude интересует военных не потому, что он "хороший". Его сила в другом: это контролировано агрессивный "ястреб", который умеет использовать достоверность угроз как стратегический ресурс.", — утверждает автор статьи.

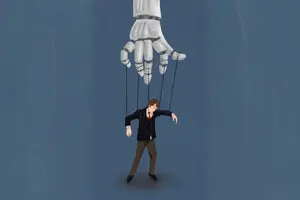

Костенко называет конфликт между компанией Anthropic и Пентагоном борьбой за характер будущей войны. В частности, за то, кто будет определять границы допустимого в сценариях ядерной эскалации — алгоритм или человек.

Войти с помощью Google

Войти с помощью Google