Единственная общая черта у этих выдуманных машин - это склонность ошибаться и вредить героям историй. HAL 9000 убил большинство членов экипажа миссини на Юпитер. А Eddie, одержимый мелочами, поставил корабль, за который он отвечает, под угрозу уничтожения. В обоих случаях попытка построить что-то полезное, приводило к появлению монстра.

Успешная научная фантастика обязательно должна играть на реальных надеждах или страхах. В 1960-х и 1970-х годах, когда HAL 9000 и Eddie были выдуманы, попытки создать искусственный интеллект были беспомощными. Поэтому страхи и надежды были гипотетическими. Но теперь все изменилось.

Об этом пишет The Economist. Машинное самообучение через технологию нейросетей, которая позволяет машине обрабатывать большие массивы данных в поисках закономерностей, способствует развитию и распространению компьютеров, которые кажутся достаточно разумными. Программы для таких машин варьируются от конвертации человеческой речи в текст до выявления ранних признаков развития слепоты. Искусственный интеллект теперь ведет контроль за качеством на заводах и управляет системами охлаждения дата-центров. Правительства надеются, что он поможет выявлять террористическую пропаганду и удалять ее из интернета. Кроме того, искусственный интеллект занимает центральную роль в разработке автономных автомобилей.

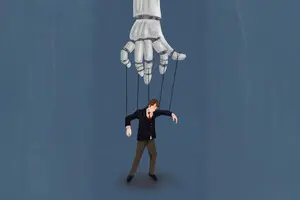

Из 10 самых дорогих компаний в мире 7 говорят, что планируют интегрировать в свои операции искусственный интеллект, который базируется на машинном самообучении. Поэтому умные машины сегодня очень близки к тем, которые были описаны в научной фантастике. Им, безусловно, не хватает осознанной мотивации, которая характерна большинству вымышленных аналогов. Но они все равно порождают страхи и надежды, которые касаются настоящего, а не неопределенного будущего. Поэтому многие люди боятся, что современный искусственный интеллект тоже может превратиться в монстра. Но этот страх связан не столько с тем, что приборы прекратят повиноваться и выполнять инструкции, как с тем, что они как раз будут их выполнять, но каким-то непостижимым образом.

Причина появления такого страха в том, что программы самообучения предусматривают обучение через изменение своих "электронных внутренностей" согласно закономерностям, которые они обнаружили в данных. Фактически они повторяют то, как, по мнению ученых, человеческий мозг учится. Силы связей между битами меняются в компьютерном коде, который разработан вести себя так, как нейроны.

Таким образом, даже разработчик нейронной сети не знает точно, как она работает после прохождения обучения. И как она именно что-то изучила. Разрешить таким машинам управлять критически важной инфраструктурой и принимать решения в медицине означает доверить жизнь людей куску оборудования, которое не известно как на самом деле работает.

Впрочем, если искусственный интеллект сможет как-то объяснить, что и почему он делает, доверие к нему возрастет. А значит он сможет быть более полезным. К тому же, если что-то пойдет не так, собственные объяснения искусственного интеллекта позволят лучше и быстрее провести расследование ошибки.

Ранее Илон Маск заявил о том, что искусственный интеллект является самой большой угрозой, с которой человечество может столкнуться как цивилизация и призвал к жесткому государственному регулированию развития искусственного интеллекта.

Войти с помощью Google

Войти с помощью Google