Розробники показали на Зимовій конференції з застосування комп'ютерного зору алгоритм, який дозволяє обдурити будь-який існуючий засіб перевірки справжності відео. Дослідники вже перевірили його на практиці і переконалися, що він працює, повідомляє Naked science.

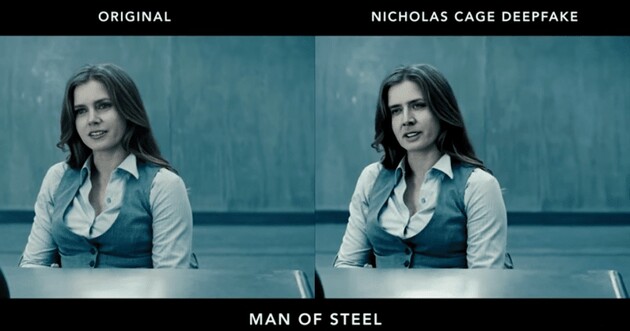

Метод обману полягає у встановленні спеціальних «конкуруючих» прикладів в кожен кадр ролика. Ефект виходить таким, що дійсно бентежить: навіть наспіх зліплений діпфейк визначається детектором як реальний запис. Хоча неприродність поведінки людини на відео очевидна неозброєним оком.

Важливим є те, що такий спосіб обману працює при перекодуванні відео і на безлічі найдосконаліших детекторів. Подібні розробки можуть ставати більш досконалими, що поставить під сумнів довіру до відеоряду, адже маніпуляції громадською думкою можуть виявитися для зловмисників набагато простіше, ніж раніше, оскільки люди звикли довіряти тому, що бачать.

Підписуйтесь на наш Telegram-канал з новинами технологій і культури.

Раніше YouTube-блогер Ctrl Shift Face за допомогою нейромережі замінив обличчя Арнольда Шварценеггера у фільмі "Термінатор 2" на обличчя Сильвестра Сталлоне. Заміна актора ніяк не вплинула на сам фільм: обох випадках Т-800 виглядає страхітливо.