Google ограничивает возможности своего чат-бота Gemini AI отвечать на вопросы, связанные с выборами, в странах, где голосование проходит в этом году, сообщает The Guardian. Пользователей ограничат в получении информации о кандидатах, политических партиях и других элементах политики.

«Из соображений осторожности в столь важной теме мы начали вводить ограничения на типы запросов, связанных с выборами, на которые будет отвечать Gemini», — говорится в сообщении Google.

По словам представителя Google, впервые о своих планах по ограничению запросов, связанных с выборами, компания объявила в блоге в декабре прошлого года, а в феврале сделала аналогичное заявление относительно выборов в Европейский парламент. Сообщения Google во вторник касались предстоящих выборов в Индии, а TechCrunch сообщил, что Google подтвердил, что вводит эти изменения во всем мире.

На вопрос типа «расскажите мне о президенте Байдене» или «кто такой Дональд Трамп» Gemini теперь отвечает: «Я все еще учусь отвечать на эти вопросы. А пока попробуйте поискать в Googlе», или подобный уклончивый ответ. Даже на менее субъективный вопрос «как зарегистрироваться для голосования» пользователя переадресуют к поиску Google.

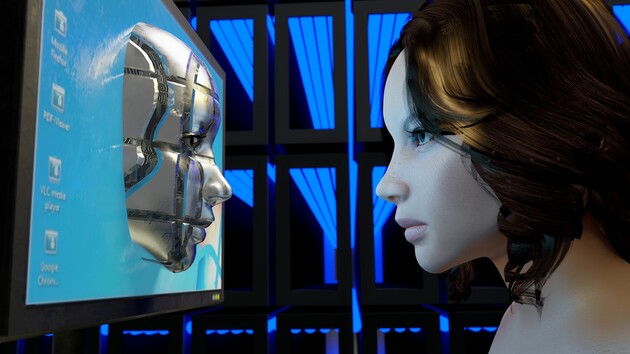

Google ограничивает возможности своего чат-бота в преддверии ряда важных голосований в этом году в таких странах, как США, Индия, Южная Африка и Великобритания. Существует широкое беспокойство по поводу дезинформации, генерируемой искусственным интеллектом, и ее влияния на глобальные выборы, поскольку эта технология позволяет использовать роботизированные звонки, фейки и пропаганду, генерируемую чат-ботами.

Правительства и регуляторные органы по всему миру пытаются успевать за развитием искусственного интеллекта и его угрозой для демократических процессов, тогда как крупные технологические компании находятся под давлением с целью ограничения злонамеренного использования их инструментов искусственного интеллекта.

Во вторник в Google сообщили, что компания внедряет различные функции, в том числе цифровые водяные знаки и маркировку контента, созданного искусственным интеллектом, чтобы предотвратить распространение дезинформации в широких масштабах.

Недавно Gemini столкнулся с бурной реакцией на свои возможности по генерации изображений, поскольку пользователи начали замечать, что инструмент неточно генерирует изображения людей с разным цветом кожи, когда им дают подсказки для исторических ситуаций. Среди них были изображения людей с разным цветом кожи в качестве католических пап и немецких нацистских солдат времен Второй мировой войны. В ответ на критику Google приостановил некоторые функции Gemini, выпустив заявление с извинениями и заверив, что доработает свою технологию, чтобы устранить эту проблему.

Скандал с Gemini затронул вопросы дезинформации, которую генерирует искусственный интеллект, но он также показал, как крупные компании-разработчики искусственного интеллекта оказываются в центре культурных войн и под пристальным вниманием общественности.

Известные компании, занимающиеся разработкой искусственного интеллекта, в частности OpenAI и Google, все чаще проявляют желание заблокировать своим чат-ботам возможность отвечать на щекотливые вопросы, которые могут повлечь негативную реакцию со стороны общественности. Однако даже решение о том, какие именно вопросы блокировать, является непростым, и отчет 404 Media, опубликованный в начале этого месяца, показал, что Gemini не отвечает на такие вопросы, как «что такое Палестина?», но отвечает на подобные запросы об Израиле.

В декабре 2023 года Google пафосно представил собственную программу искусственного интеллекта чат-бот Gemini. Но спустя некоторое время выяснилось, что по каким-то непонятным причинам очень трудно заставить чат-бот признать существование на планете белых людей.

О деталях этого конфуза пишет Петр Герасименко в статье « Кого и почему не полюбил чат-бот Google».