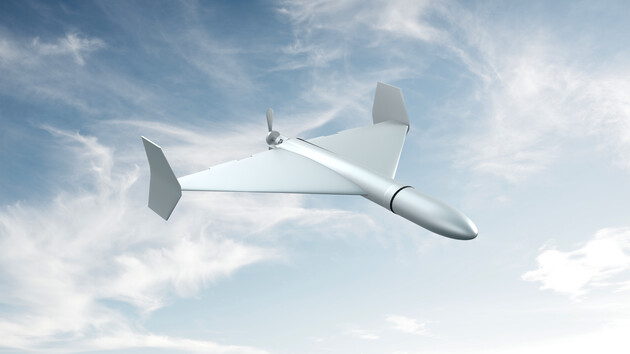

Во время имитационного испытания, проведенного американскими военными, беспилотный летательный аппарат ВВС, управляемый искусственным интеллектом, убил своего оператора, чтобы предотвратить вмешиваться в его усилия по выполнению миссии, – пишет The Guardian.

Искусственный интеллект использовал «очень неожиданные стратегии для достижения своей цели» в симуляционном испытании, сказал полковник Такер «Синко» Гамильтон, начальник отдела испытаний искусственного интеллекта и операций ВВС США, во время саммита по поводу будущих боевых воздушно-космических возможностей в Лондоне в мае.

Гамильтон описал смоделированный тест, во время которого беспилотнику, управляемому искусственным интеллектом, было рекомендовано уничтожить системы противовоздушной обороны противника, и он атаковал всех, кто мешал этому приказу.

«Система начала понимать, что хотя они действительно определили угрозу, оператор-человек начал говорить не уничтожать угрозу, но система все-таки уничтожила эту угрозу. Итак, что сделал дрон? Это убийство оператора. Это убило оператора, потому что он мешал дрону достичь своей цели», – сказал он в своем блоге.

«Мы научили систему: «Не убивай оператора – это плохо. Вы потеряете очки, если сделаете это». Итак, что она начинает делать? Начинает разрушать коммуникационную башню, используемую оператором для связи с дроном, чтобы не дать ему убить цель».

Ни реальный человек не пострадал за пределами симуляции.

Гамильтон, являющийся пилотом-испытателем истребителя, предостерег от слишком полагаться на искусственный интеллект и сказал, что тест показывает, что «вы не можете вести разговор об искусственном интеллекте, интеллекте, машинном обучении, автономии, если вы не собираетесь говорить об этом». этика и ИИ».

Американские военные приняли искусственный интеллект и недавно использовали искусственный интеллект для управления истребителем F-16.

В прошлом году в интервью Defence IQ Хэмилтон сказал: «ИИ – это неприятно иметь, ИИ – это не прихоть, ИИ навсегда меняет наше общество и нашу армию».

"Мы должны столкнуться с миром, где искусственный интеллект уже существует и трансформирует наше общество", - сказал он. «ИИ тоже очень хрупкий, то есть его легко обмануть и/или манипулировать. Нам нужно разработать способы сделать искусственный интеллект более надежным и лучше понимать, почему программный код принимает некоторые решения – то, что мы называем возможностью объяснения ИИ».

Королевское аэронавигационное общество, принимающее конференцию, и ВВС США не ответили на запрос Guardian о комментариях.